損失関数とは何ですか?初心者にも分かりやすく解説

損失関数とは、機械学習のモデルがどれだけ誤差を犯しているかを測るための重要な概念です。この関数は、予測値と実際の値の差異を数値化し、モデルの性能を評価します。初心者にとっても理解しやすいように、本記事では損失関数の基本から応用まで丁寧に解説します。損失関数の種類や、どのように選択すべきか、またその最適化方法についても触れていきます。この記事を読むことで、モデルの精度向上のための第一歩を踏み出すことができます。

損失関数の基本概念と初心者向け解説

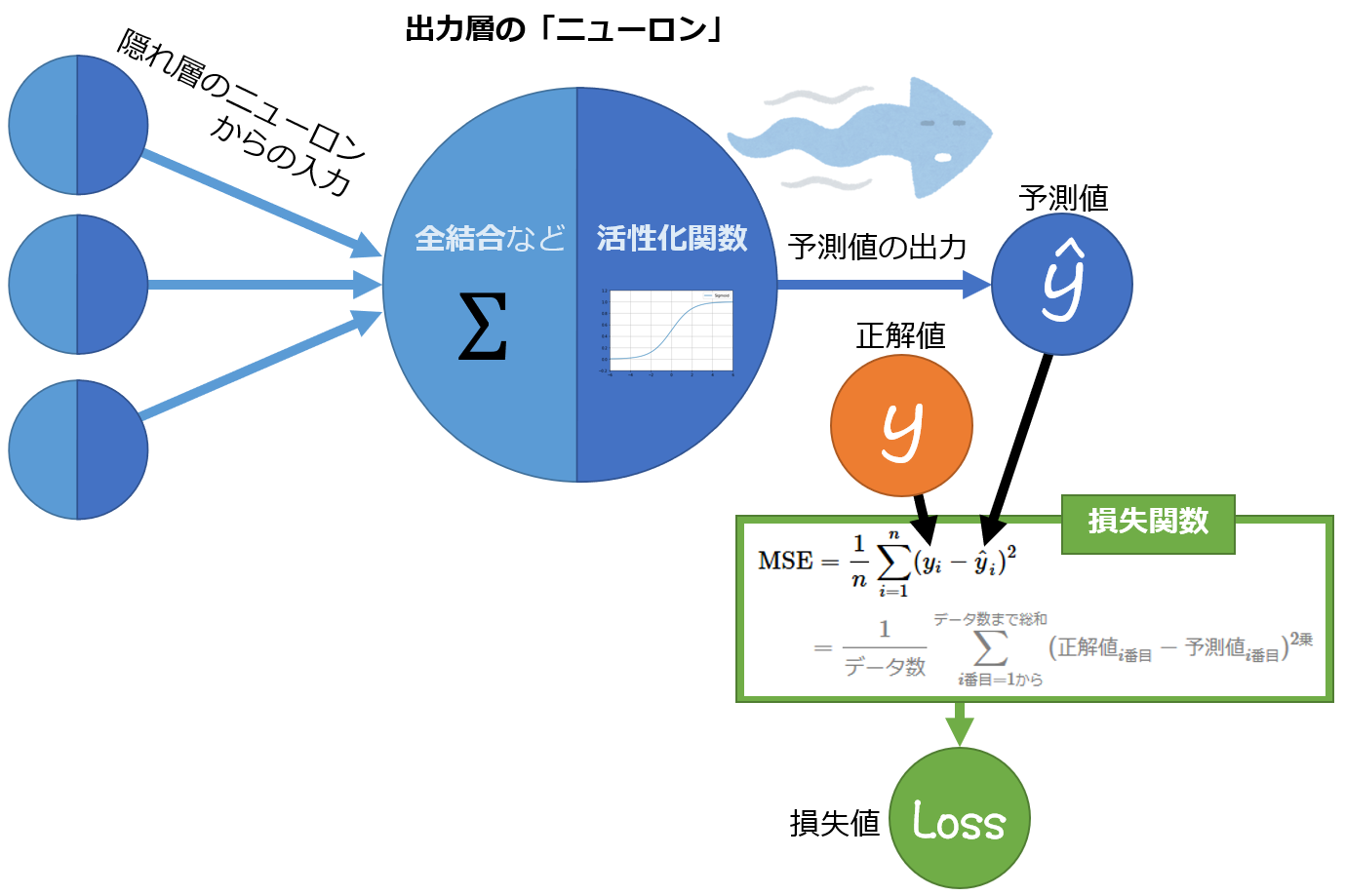

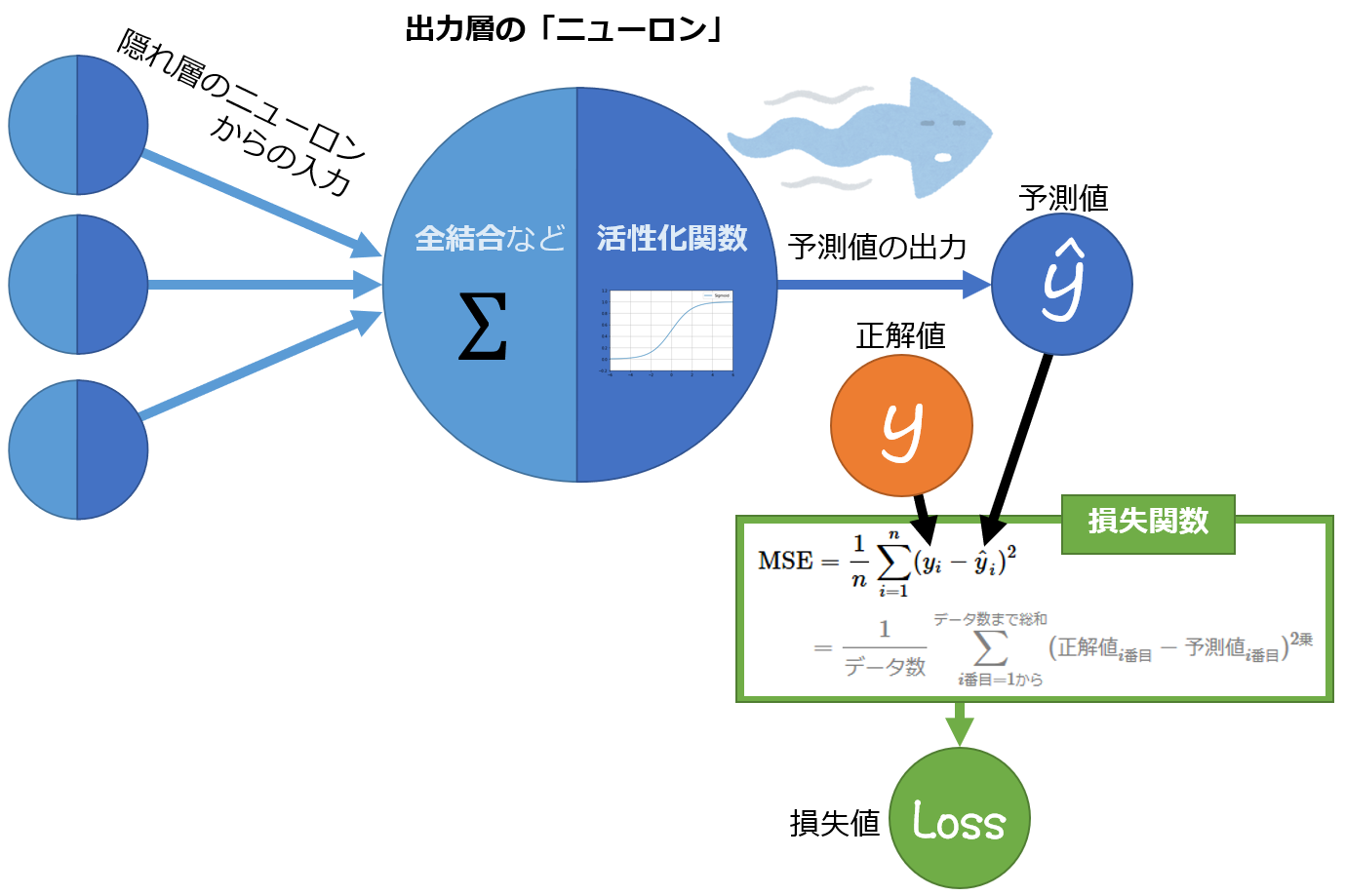

損失関数とは、機械学習のモデルが予測した出力と正解の間の誤差を測定するための関数です。この関数の値が低いほど、モデルの精度が高いことを示します。損失関数は、モデルの訓練中に使用され、モデルのパラメータを調整するために最適化されます。

損失関数の重要性

損失関数は、モデルの性能を評価し、最適化するために不可欠な要素です。具体的には、損失関数が低ければ低いほど、モデルの予測性能が向上するため、適切な損失関数を選択し、その値を最小化することが重要です。また、損失関数は、異なる種類のタスク(分類、回帰、 etc.)に対して最適な結果を出すために不同的に使用されます。

Safariがクラッシュ?解決策を紹介!今すぐできる対処法一般的な損失関数の種類

損失関数には、様々な種類がありますが、主に以下のものがあります:

- 平均二乗誤差 (MSE): 回帰問題で使用される代表的な損失関数です。予測値と正解の差の平方の平均を計算します。

- スエントロピー損失: 分類問題で使用される代表的な損失関数です。予測確率分布と正解の分布の差異を測定します。

- Hinge Loss: サポートベクターマシン (SVM) などの線形分類器で使用される損失関数です。

- Huber Loss: 平均二乗誤差と平均絶対誤差の中間的な性質を持つロバストな損失関数です。

- Mean Absolute Error (MAE): 予測値と正解の差の絶対値の平均を計算します。

損失関数の選択基準

損失関数を選択する際には、以下の点を考慮することが重要です:

- 問題の種類: 回帰タスクにはMSEやMAE、分類タスクにはスエントロピー損失などが適しています。

- データの特性: 外れ値が多いデータにはHuber Lossなどのロバストな損失関数が適しています。

- 計算の複雑さ: 計算量が少ない損失関数は、訓練時間を短縮するため効率的です。

- 目的の精度: 高精度を追求する場合は、複雑な損失関数を選択することが適しています。

損失関数の最適化手法

損失関数を最小化するための最適化手法には、以下のものがあります:

- 勾配降下法 (Gradient Descent): 損失関数の勾配を利用して、パラメータを更新する方法です。

- 確率的勾配降下法 (Stochastic Gradient Descent, SGD): データセットの一部を用いて勾配を計算し、パラメータを更新する方法です。

- Adam (Adaptive Moment Estimation): 勾配とその平方の移動平均を利用した最適化手法です。

- RMSprop (Root Mean Squared Propagation): 勾配の平方の移動平均を利用して学習率を調整する方法です。

- Adamax: Adam の変種で、学習率の上限を設定することでより安定的な最適化を実現します。

損失関数の実装例

以下は、Python で平均二乗誤差 (MSE) を実装する例です:

本当に当たるの?人気占いアプリ「バケタン」徹底検証 import numpy as np def mean squared error(y pred, y true): return np.mean((y pred - y true) 2) 例 y pred = np.array([1.0, 2.0, 3.0]) y true = np.array([1.5, 1.0, 3.5]) mse = mean squared error(y pred, y true) print(MSE:, mse) この例では、予測値y predと正解y trueの差の平方の平均を計算しています。

| 損失関数 | 用途 | 特徴 |

|---|---|---|

| 平均二乗誤差 (MSE) | 回帰問題 | 予測値と正解の差の平方の平均を計算します。 |

| スエントロピー損失 | 分類問題 | 予測確率分布と正解の分布の差異を測定します。 |

| Hinge Loss | 線形分類器 (SVM など) | 予測スコアと正解ラベルの差異を測定します。 |

| Huber Loss | ロバストな損失関数 | 平均二乗誤差と平均絶対誤差の中間的な性質を持ち、外れ値に強靭です。 |

| Mean Absolute Error (MAE) | 回帰問題 | 予測値と正解の差の絶対値の平均を計算します。 |

教師あり学習における損失関数とは?

教師あり学習における損失関数とは、モデルの予測値と実際の正解値との間の差異を数値化した関数のことを指します。この関数は、学習プロセスの最適化において重要な役割を果たし、モデルが予測を改善する方向を示します。損失関数は、最小化されるように設計されており、その値が小さくなるほど、モデルの性能が向上していることを示します。

損失関数の種類と特徴

損失関数には様々な種類があり、それぞれが特定の問題に対応しています。代表的なものには以下のものがあります:

ユニークな名前のJSライブラリ3選をご紹介!- スエントロピー損失関数:分類問題で多く使用され、特に多クラス分類では Softmax 関数と組み合わせて用いられます。

- 平均二乗誤差損失関数:回帰問題で一般的に用いられ、予測値と正解値の二乗差の平均を計算します。

- ヒンジ損失関数:サポートベクターマシン(SVM)で使用され、クラス間のマージンを最大化することを目指します。

損失関数の最適化手法

損失関数を最小化するために、様々な最適化手法が用いられます。これらの手法は、モデルのパラメータを効率的に更新し、学習の収束を促します。

- 勾配降下法(Gradient Descent):最も基本的な最適化手法で、損失関数の勾配を計算することでパラメータを更新します。

- 確率的勾配降下法(Stochastic Gradient Descent, SGD):データセットからランダムにサンプルを選択し、それらに対して勾配を計算することで、学習速度を向上させます。

- Adam 最適化法(Adaptive Moment Estimation):勾配の一次モーメント(平均)と二次モーメント(分散)を用いて、効率的なパラメータ更新を行います。

損失関数の選択基準

損失関数を選択する際には、問題の性質やモデルの特性に応じて適切なものが選ばれます。

- 問題の種類:分類問題ではスエントロピー損失関数、回帰問題では平均二乗誤差損失関数がよく用いられます。

- データの特性:sigmoid 関数を用いた分類では、対数損失関数が適しています。また、データに異常値が含まれる場合、ロバストな損失関数(例:Huber 損失関数)が適しています。

- コンピューティング リソース:計算量やメモリ使用量を考慮し、リソースに制約がある場合は、計算効率の高い損失関数を選択することが重要です。

機械学習の損失関数の一覧は?

機械学習において、損失関数はモデルの予測がどれほど目標値と一致しているかを評価する重要な指標です。以下に代表的な損失関数を一覧で紹介します。

合格しやすい稟議書を作成する5つのポイントとは?回帰問題の代表的な損失関数

回帰問題では、連続値を予測する際によく使用される以下の損失関数があります。

- 平均平方誤差(Mean Squared Error, MSE):予測値と実際の値の差の2乗の平均を計算します。過学習に敏感であるため、正規化などの手法を併用することが多いです。

- 平均絶対誤差(Mean Absolute Error, MAE):予測値と実際の値の差の絶対値の平均を計算します。外れ値の影響を受けにくいという特徴があります。

- Huber損失:MSEとMAEの特徴を組み合わせた損失関数で、予測誤差が小さい場合はMSE、大きい場合はMAEの特性をもたせることができます。

分類問題の代表的な損失関数

分類問題では、クラスラベルを予測する際によく使用される以下の損失関数があります。

- スエントロピー損失(Cross-Entropy Loss):二値分類ではバイナリスエントロピー、多クラス分類ではカテゴリカルスエントロピーが使用されます。予測確率と実際のラベルの乖離を測定します。

- ヒンジ損失(Hinge Loss):主にサポートベクターマシン(SVM)で使用されます。予測値と実際のクラスラベルの間のマージンを最大化することを目指します。

- 対数損失(Logarithmic Loss):確率予測の品質を評価する損失関数で、予測確率が実際のラベルにどれだけ近いかを測定します。

特殊な損失関数

特定の状況やタスクに適した特化された損失関数も存在します。

- コサイン類似度損失(Cosine Similarity Loss):ベクトルの方向の類似度を測定する損失関数で、自然言語処理や画像検索などで使用されます。

- 対照的損失(Contrastive Loss):類似度学習で使用され、正例と負例の距離を制御します。正例を近づけ、負例を遠ざけることを目指します。

- トリプレット損失(Triplet Loss):識別力のある特徴ベクトルを学習する際に使用されます。正例とアンカー、負例の三つ組の距離関係を最適化します。

AI学習における損失とは?

AI学習における損失とは、モデルが与えられたタスクをどれだけ正確にこなせるかを測定するための指標です。この損失は、モデルの予測値と実際の正解値との間の違いを数値化したものです。損失が低いほど、モデルの予測が正解に近いことを意味し、逆に損失が高いほど、モデルがタスクをうまくこなせていないことを示します。AI学習では、この損失を最小限に抑えることが目標となります。

損失関数の種類

損失関数は、モデルの性能を評価するための様々な形式があります。主な損失関数には以下のものがあります:

- 平均二乗誤差(Mean Squared Error, MSE): 予測値と正解値の差の二乗の平均を計算します。回帰問題でよく使用されます。

- スエントロピー損失(Cross-Entropy Loss): クラス分類タスクで使用される頻度が高く、予測した確率分布と正解の確率分布の違いを測定します。

- ヒンジ損失(Hinge Loss): サポートベクターマシン(SVM)などの分類問題で使用される損失関数で、予測値と正解値の間のマージンを最大化します。

損失の最適化

損失の最小化は、AIモデルの学習過程において非常に重要な役割を果たします。最適化アルゴリズムは、以下のメカニズムを通じて損失を最小化します:

- 勾配降下法(Gradient Descent): 目的関数(損失関数)の勾配を計算し、その逆方向にパラメータを更新することで、損失を徐々に小さくしていきます。

- 確率的勾配降下法(Stochastic Gradient Descent, SGD): 一度に1つのデータポイントを使用して勾配を計算し、より高速な収束を達成します。

- アダム最適化(Adam Optimization): 勾配の1次モーメントと2次モーメントを計算し、効率的に最適化を進めます。

損失指標の監視と評価

モデルの学習過程では、損失指標を定期的に監視し、モデルの性能を評価することが重要です。以下の方法が一般的に使用されます:

- 学習曲線(Learning Curves): 損失値の変化をグラフにプロットし、モデルの学習状況を視覚的に確認します。

- 検証データセットの使用: トレーニングデータとは別に用意した検証データで損失を評価し、過学習やアンダーフィッティングを検出します。

- 早期停止(Early Stopping): 検証データでの損失が一定回数改善しない場合、学習を早期に停止することで過学習を防止します。

よくある質問

損失関数とは具体的に何ですか?

損失関数は、機械学習モデルの予測値と実際の値との誤差を測定するための関数です。この関数は、モデルのパフォーマンスを評価し、予測の正確性を向上させるために使用されます。損失関数の値が低いほど、モデルの予測は実際のデータに近づきます。一般的に、異なる問題に対して最適な損失関数が異なるため、選び方には注意が必要です。

損失関数はどのように使い分けますか?

損失関数の選択は、問題の種類や目的に大きく依存します。例えば、回帰問題では平均二乗誤差(MSE)や平均絶対誤差(MAE)がよく使用されます。分類問題では、スエントロピー損失が一般的です。また、特定の問題に適したカスタムの損失関数を設計することもあります。重要なのは、選んだ損失関数がモデルの学習目標と一致していることです。

損失関数の最小化とは何ですか?

損失関数の最小化は、機械学習モデルの最適化の過程で行われます。この過程では、モデルのパラメータを調整して損失関数の値をできるだけ小さくします。この最小化は、通常、勾配降下法などの最適化アルゴリズムを用いて行われます。損失関数を最小化することで、モデルはトレーニングデータに対する予測性能を最大化します。

損失関数と評価指標の違いは何ですか?

損失関数と評価指標は、機械学習のプロセスにおいて異なる役割を果たします。損失関数は、モデルの学習中に使用され、予測値と真の値の誤差を測定し、モデルのパラメータを調整するために用いられます。一方、評価指標は、モデルの最終的な性能を測定するために使用され、通常、トレーニングデータとは別のテストデータに対して計算されます。一般的な評価指標には、精度、再現率、F1スコアなどがあります。